Les fausses images : comment les reconnaître et s’en protéger ?

Quand c’est trop beau pour être vrai… c’est souvent faux. Hier, sur Facebook, je vois un post avec une image qui fait sensation : un champ de tulipes multicolores, parfaitement alignées, aux couleurs éclatantes. Plus de 10 000 likes, des commentaires admiratifs : « C’est splendide ! », « C’est où ? J’aimerais tellement y aller ! ». Pourtant, ce lieu n’existe pas. Cette image a bien sûr été générée par une intelligence artificielle.

Ces fausses images prolifèrent et trompent des milliers, voire des millions de personnes chaque jour. Parfois inoffensives, elles sont aussi utilisées pour manipuler l’opinion, propager de fausses informations ou même arnaquer.

Certaines sont utilisées pour collecter vos données personnelles, vous suivre, etc. Cf.paragraphe 2.

Aujourd’hui, je vous donne quelques informations et outils qui peuvent vous aider à distinguer le vrai du faux !

Des fausses images partout : deepfakes et illusions numériques

Les fausses images ne sont pas nouvelles, mais en 2025, elles atteignent un niveau de réalisme inédit. Grâce à l’intelligence artificielle (IA), il est désormais possible de créer en quelques secondes des paysages, des visages et même des événements qui n’ont jamais existé. On parle souvent des deepfakes, ces images ou vidéos modifiées pour faire dire ou faire faire n’importe quoi à n’importe qui.

➜ Exemples récents :

- Images historiques falsifiées : Des générateurs d’images par IA permettent de créer des photos « historiques » en quelques secondes, inondant Internet de clichés falsifiés. ICI

- Usurpation d’identité : Des femmes et des adolescentes ont découvert de fausses images d’elles trafiquées par l’intelligence artificielle et diffusées sans leur consentement dans des canaux de discussion privés sur l’application Telegram. ICI

- Contenus à caractère sexuel : Des millions d’images trafiquées à caractère sexuel, générées par des usines à deepfakes, infestent le web, rendant leur contrôle presque impossible. ICI

- Images improbables visant les internautes âgés : Des publications virales sur Facebook utilisent des images générées par IA pour tromper les internautes, en particulier les plus âgés. Ces posts montrent des photos improbables, comme une grand-mère réalisant des travaux manuels ou des femmes aux proportions physiques exagérées, souvent accompagnées de messages demandant des « félicitations » ou « évaluations ». Ces publications, appelées « boomer traps », exploitent la crédulité des générations plus anciennes. lemonde.fr

Parfois, ce n’est pas juste une image… c’est un piège pour collecter vos informations personnelles

Certaines images virales ne servent pas uniquement à faire rêver ou à choquer. Elles peuvent être utilisées pour collecter discrètement tes données, voire pire.

✔️ Lorsque vous cliquez, partagez ou consultez une image hébergée sur un serveur externe, votre appareil envoie des informations techniques : adresse IP, type de navigateur, localisation approximative. Certains groupes exploitent ces interactions pour suivre le comportement des internautes, constituer des profils ou les rediriger vers des sites à but commercial ou politique, voire pirater leur téléphone ou ordinateurr.

Autrement dit, une image peut devenir un outil de pistage ou de piratage, en particulier lorsqu’elle est partagée massivement sur les réseaux sociaux sans vérification. Ce n’est pas systématique, mais c’est une réalité.

Au-delà des images : la montée en puissance des fausses informations

Les images ne sont qu’une partie du problème. Elles accompagnent souvent des fake news pour leur donner plus de crédibilité.

➜ Exemples frappants :

- Affaire Diddy : Un déferlement de fausses informations, images et vidéos détournées a envahi les réseaux sociaux, ternissant la réputation du producteur et rappeur américain. ICI

- Ouragan Helene : Des deepfakes montrant des victimes fictives de l’ouragan ont circulé sur les réseaux sociaux, compliquant les efforts de secours et créant de fausses narrations.

- Présidentielle américaine 2024 : L’équipe de campagne de Donald Trump a utilisé l’IA pour diffuser des images humoristiques et absurdes, détournant l’attention des électeurs et brouillant les frontières entre réalité et fiction. ICI

Où en est la législation en avril 2025 ?

En France, il n’existe pas encore de législation imposant explicitement d’indiquer qu’un contenu a été généré par intelligence artificielle (IA). Cependant, une proposition de loi déposée à l’Assemblée nationale le 3 décembre 2024 vise à instaurer une obligation de mention explicite pour les images générées ou modifiées par IA sur les réseaux sociaux. village-justice.com

C’est tout de même incroyable, je trouve ! Ce n’est tout de même pas si compliqué de préciser qu’une image a été générée artificiellement. Cela éviterait une partie des manipulations et limiterait la propagation de fausses informations. Pourtant, aujourd’hui, rien n’oblige une plateforme ou un utilisateur à signaler qu’une image a été créée par une IA, ce qui laisse la porte ouverte à toutes sortes de dérives.

Les deepfakes, les montages trompeurs et les visuels sensationnalistes circulent sans encadrement strict, et beaucoup de personnes continuent à tomber dans le piège. En l’absence d’une loi claire, tout repose sur la vigilance des internautes et sur l’éthique des créateurs de contenu.

Comment repérer les fausses images ?

Déjà, l’observation ! Observez de près l’image

❌ Doigts mal formés, yeux asymétriques, bijoux ou objets déformés.

❌ Problèmes d’ombres et de lumières incohérents.

❌ Textes flous ou illisibles sur les pancartes ou vêtements.

➡ Les IA ont encore du mal avec ces détails, mais c’est de mieux en mieux !

Ensuite : Se méfier des émotions trop fortes

Si une image suscite une émotion extrême, faites une pause !

➡ Les fausses images cherchent souvent à provoquer l’indignation ou l’émerveillement pour être partagées rapidement.

➡ Exemples courants : catastrophes exagérées, paysages trop parfaits, scènes choc.

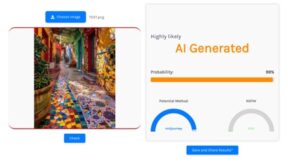

Puis les outils (en avril 2025)

Il existe des outils simples et accessibles pour ne plus se faire avoir. Voici les meilleurs (en mars 2025) pour M. Tout-le-Monde et ceux pour les plus curieux.

Outils simples pour M. Tout-le-Monde

Alors, oui il existe des outils…, mais la réponse n’est pas toujours très fiable… J’ai généré 7 images par IA, aucun n’a vraiment donné la bonne réponse…

Mais, je vous les donne tout de même, et mettrai à jour la rubrique au fur et à mesure…

- Recherche inversée d’image (Google, Bing, Yandex) → Permet de voir où l’image a été publiée ailleurs.

- AI or Not (ICI) → Indique si une image est générée par IA.

- DeepFakeProof (extension navigateur) → Détecte automatiquement les deepfakes sur les pages visitées.

Is It AI? : Ce site permet de déterminer si une image a été générée par une IA ou par un humain, en fournissant un pourcentage de probabilité.

Soyons vigilants !

Les fausses images sont partout, et ce n’est que le début. Alors, si vous voyez une image trop belle ou trop choquante pour être vraie, prenez 30 secondes pour la vérifier. Et, surtout, alertez ceux qui y croient !

À nous de jouer ! Et bien sûr, l’image de cet article est une image générée par l’IA

Cet article vous a intéressé ? Dans le même esprit, vous pouvez lire

- Les manipulations des vendeurs de bien-être

- Les faux avis

- L’utilisation de vos données personnelles par les applis de bien-être

- Les faux concours Facebook et Instagram

- La triche sur Strava

N’hésitez pas à en lire d’autres dans les autres rubriques : culture générale ou sur la page d’accueil ou à le partager sur Facebook